在汽车总装车间,装配定位的精度直接决定整车品质与生产节拍。传统方案依赖高精度工装夹具、机械硬限位或2D视觉辅助,但面对车型混线生产、零部件公差波动、车身姿态偏移等现实挑战,常常陷入“卡不住、对不准、调不快”的困境。3D视觉引导技术的成熟,正将装配定位从“被迫适应设备”推向“设备主动适应零件”的新范式。

传统定位的三大痛点

硬限位缺乏柔性:机械夹具只能匹配特定车型,切换车型需人工更换或调整,耗时且易出错。混线生产时,不同车型的定位孔位置、零件轮廓差异让固定工装捉襟见肘。

2D视觉信息不足:普通相机只能获取平面XY坐标,缺少深度(Z轴)和角度信息。当螺栓孔位被遮挡、零件倾斜或来料姿态随机时,2D视觉无法输出完整的六自由度位姿,导致机器人抓取或装配时发生碰撞或对位偏差。

车身与零件双重公差累积:白车身焊接误差、涂装高温变形、输送线停位偏移……这些公差叠加后,传统“示教-再现”模式下的机器人只能按照预设轨迹盲走,根本无法感知实际位置差异。

3D视觉引导:让机器人“看见”并“适应”真实位置

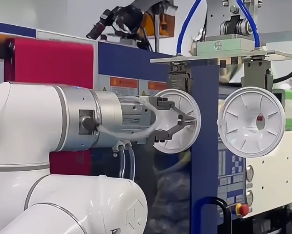

3D视觉引导的核心,是通过结构光、激光条纹或双目立体成像,实时获取目标物体(如车门铰链孔、底盘螺栓、风挡玻璃边框)的高精度三维点云,经算法处理后输出精确的空间位姿,引导机器人动态修正轨迹。具体工作流如下:

第一步:在线扫描与点云生成

当车身随输送线到达工位后,固定在机器人末端或工位侧的3D相机在1秒内完成对关键特征的扫描,输出百万级点云数据。即便零件表面有油污、高反光或低纹理,新一代成像技术仍能稳定提取边缘和孔位特征。

第二步:位姿计算与偏差补偿

将实时点云与标准CAD模型进行配准比对,得到物体在六个自由度(X、Y、Z、Rx、Ry、Rz)上的实际偏移量。例如风窗玻璃安装时,系统可识别出玻璃框相比理论位置顺时针偏转了0.3度、下沉了1.2毫米,随即生成补偿路径。

第三步:实时引导机器人装配

补偿路径通过以太网以毫秒级延迟发送给机器人控制器,机器人不再按原始示教点运动,而是依据视觉反馈的动态目标位置进行伺服调整。对于螺栓拧紧、饰条粘贴、底盘合装等高精度工序,重复定位精度可达±0.2毫米以内。

关键应用场景解析

车门铰链安装:3D视觉定位铰链安装孔的空间坐标,引导机器人抓取铰链并完成对孔插入。即使车门因重力下垂或前工序公差导致孔位偏移,依然能自适应对准。

风挡玻璃涂胶与装配:扫描车身窗框的实际轮廓生成三维胶线轨迹,同时引导玻璃抓具将玻璃精确对位到窗框中心。相比机械定心机构,视觉方案可容忍±5毫米的车身偏移。

底盘动力总成合装:车身落位于合装台后,视觉系统同时定位车身上的多个悬置安装点,引导举升平台微调位置,消除副车架与车身之间的累积误差。

座椅与内饰安装:针对软性内饰件的弹性变形,3D视觉可识别实际安装边界,引导机器人以匹配姿态完成卡扣压入,避免刮伤表面。

系统架构与落地要点

一套稳健的3D视觉引导系统需关注:

相机选型:大视野场景(如底盘合装)选用激光轮廓仪;高精度小场景(如铰链安装)选用结构光相机。

标定与手眼关系:精确标定相机坐标系与机器人基坐标系、工具坐标系之间的变换矩阵,是精度达标的基石。

节拍匹配:视觉计算时间需控制在工位节拍的20%以内,通常要求扫描+处理≤2秒。

环境鲁棒性:采用偏振或蓝光光源,降低总装车间环境光与车身金属反光的干扰。

效果与未来趋势

导入3D视觉引导后,典型收益包括:装配定位精度提升至±0.3mm以内;车型切换无需机械调整,换产时间从小时级降至分钟级;因对位不准导致的返工率降低70%以上。更重要的是,该技术为“柔性生产”和“即插即用”的机器人单元铺平了道路。

未来,随着边缘计算算力提升和嵌入式3D传感器的小型化,视觉引导将向“极速、融合、自学习”演进:与力控融合实现“边看边感觉”的精密装配;利用少量样本即可适应全新零部件,彻底告别繁琐的点云模板制作。

3D视觉引导不是对传统定位的改良,而是重构了“感知-决策-执行”的闭环。在汽车行业从大批量标准化向大规模定制化转型的今天,它已成为总装线上不可或缺的“眼睛”与“方向盘”。